Adobe Research

VIDEO: Adobeov AI detektira manipulirani video

Istraživači su napravili AI alat koji može prepoznavati deepfake manipulacije u videu.

Adobeovi istraživači objavili su znanstveni rad u kojem opisuju svoj novi alat za prepoznavanje manipulacija u video filmovima koji se može koristiti za borbu protiv takozvanih deepfakeova.

Ako vam nije poznato, deepfake je metoda manipulacije videom u kojoj se algoritmi dubokog učenja (deep learninga) uvježbavaju na velikim setovima slika, video filmova i audio datoteka raznih osoba, kako bi računalo na uvjerljivi način moglo imitirati facijalne izraze, glas, kretnje i mimiku neke osobe, što omogućuje da druga osoba svoje riječi doslovce stavlja u tuđa usta, pa se može reći da na taj način možete upravljati ljudima u videu, kako bi govorili ono što nisu doista izrekli. Pored toga, alati strojnog učenja mogu spajati i lica, čime se dobiju lude kombinacije, kao što možete vidjeti u ovom videu.

Mada je većinu tih manipulacija s poznatim osobama koje možete pronaći na YouTubeu vrlo lako prepoznati, kada se deepfake koristi na običnim ljudima uz ogromne baze podataka, AI je u stanju manipulacije učiniti neprimjetnima, što može stvoriti velike probleme ljudima koji postanu žrtvama deepfakea.

Istraživači Adobea su stoga u suradnji s računalnim znanstvenicima Sveučilišta California razvili AI alat koji je u stanju detektirati manipulirana lica u videu čak i kada su "fejkeri" napravili jako dobar posao. AI je napravljen tako da prepoznaje korištenje Adobeovog alata pod nazivom Face Aware Liquify, koji "warpira" elemente nečijeg lica.

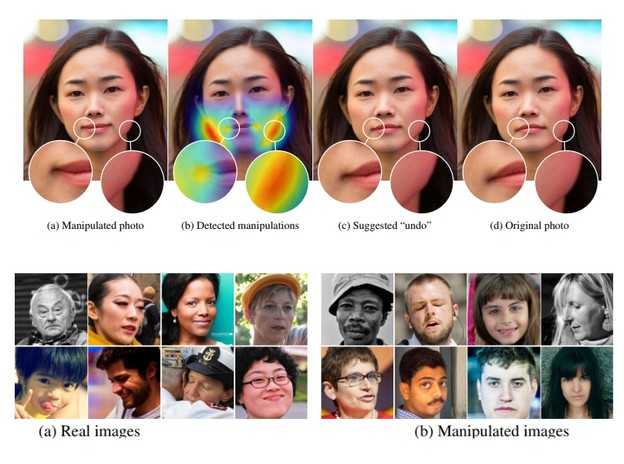

Umjetna inteligencija traži sićušne detalje koje ljudi nisu u stanju detektirati, a osim otkrivanja manipulacija, u stanju je vratiti manipuliranu sliku u originalno stanje.

Istraživanje je ukazalo da su ljudi bili u stanju detektirati lažnjake u 53 posto slučajeva, je AI to uspješno obavio s točnošću od 99 posto. Gavin Miller, šef Adobe Researcha, izjavio je da je ovo veliki iskorak u detekciji specifičnih oblika editiranja videa i slika, a vraćanje u originalno stanje funkcionira izuzetno dobro. Također je dodao kako je osim tehnologija poput ove, najbolja obrana protiv zlonamjernog deepfakea u tome što će ljudi znati kako sadržaji mogu biti manipulirani, pa neće prihvaćati kompromitirajuće snimke kao zdravo za gotovo.

Učitavam komentare ...